Hate Speech und politische Propaganda beschäftigen die öffentliche Diskussion nicht erst seit Donald Trumps Wahl 2016. Der für viele schockierende Erfolg des Populisten hat in den westlichen Demokratien und in den Zentralen von Facebook, Twitter und Co. die Alarmglocken läuten lassen. Sehr aktiv suchen Politik und Digitalwirtschaft nach Wegen, dem Problem von Hass und Lüge in den sozialen Medien Herr zu werden. Kurz vor der Sommerpause und der heißen Phase der Bundestagswahl hat der Bundestag das NetzDG verabschiedet, das Hasspropaganda in den sozialen Medien einen Riegel vorschiebt – und gleichzeitig die freie Meinungsäußerung erheblich einschränkt. Kritiker warnen zu Recht vor den Folgen des schwammig und zu weit gefassten Gesetzes (so auch dieser Autor).

Hate Speech und politische Propaganda beschäftigen die öffentliche Diskussion nicht erst seit Donald Trumps Wahl 2016. Der für viele schockierende Erfolg des Populisten hat in den westlichen Demokratien und in den Zentralen von Facebook, Twitter und Co. die Alarmglocken läuten lassen. Sehr aktiv suchen Politik und Digitalwirtschaft nach Wegen, dem Problem von Hass und Lüge in den sozialen Medien Herr zu werden. Kurz vor der Sommerpause und der heißen Phase der Bundestagswahl hat der Bundestag das NetzDG verabschiedet, das Hasspropaganda in den sozialen Medien einen Riegel vorschiebt – und gleichzeitig die freie Meinungsäußerung erheblich einschränkt. Kritiker warnen zu Recht vor den Folgen des schwammig und zu weit gefassten Gesetzes (so auch dieser Autor).

Facebook und Twitter ihrerseits gehen das Problem in vorauseilendem Gehorsam bereits jetzt an – mit unterschiedlichem Erfolg. Nachdem Facebooks interne Richtlinien für die Sperrung von Inhalten bekannt worden sind, wird klar, wie unbeholfen der Branchenprimus agiert. Twitter dagegen scheint seine algorithmengesteuerte Zensurmaschine so scharf gemacht zu haben, dass sie reihenweise “false positives” produziert. Zahlreiche User beschweren sich darüber, digital mundtot gemacht zu sein; ihre Tweets sind nur noch ihren Followern sichtbar, nicht mehr aber in der offenen Suche. Ein Vorgang, der weder transparent ist, noch angefochten werden kann. Die Existenz dieses “Shadowban” bestritt Twitter prompt, und bezeichnete ihn als einen Fehler der Spam-Bekämpfung. Doch ein Blick in die Nutzungsbedingungen beschreibt exakt die Maßnahmen, die einen Shadowban auszeichnen:

“…wir identifizieren mittels technischer Methoden solche Accounts, die beleidigendes […] Verhalten zeigen. Wenn dies der Fall ist, ergreifen wir Maßnahmen, um bestimmte Funktionen zu beschränken. So können Tweets zeitweise etwa nur Followern sichtbar gemacht werden…”

Subgruppen nicht geschützt

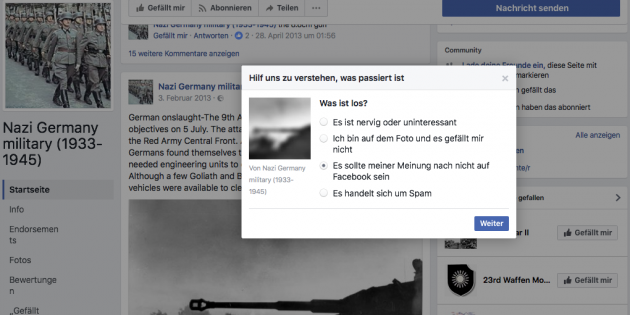

Facebook hat hingegen ein Regelwerk entworfen, das absurde Blüten treibt. Hasskommentare sind nur dann nicht zulässig, wenn sie eine der geschützten Gruppen betreffen. Diese sind definiert durch ihre Abgrenzung durch Geschlecht, Religion, Nationalität, Genderidentität, Rasse, Volkszugehörigkeit, sexuelle Orientierung und Krankheit oder Behinderung. Doch dieser Schutz verfällt, sobald sich ein Hasskommentar gegen eine nicht geschützte Subgruppe richtet: etwa eine bestimmte Alterskategorie, oder Vertreter eines Berufs. Afroamerikanische Kinder sind also nicht geschützt, weiße Männer sehr wohl.

Nur Menschen können Content effektiv kontrollieren

Die beiden Beispiele zeigen, dass es ungemein schwierig ist, die große Bandbreite der Kommunikation in klare Regeln zu fassen. Hate Speech oder Fake News sind Stand heute nicht mit Algorithmen in den Griff zu bekommen. Es bedarf der menschlichen Intelligenz, und die ist teuer. Die Wirtschaftsbetriebe Facebook und Twitter sind zurückhaltend dabei, große Teams von Content-Kontrolleuren einzustellen. Das NetzDG ist darauf ausgelegt, sie dazu zu zwingen. In der endgültig beschlossenen Fassung sieht es vor, dass die Betreiber der sozialen Medien eine unabhängige “Einrichtung der Regulierten Selbstregulierung” anrufen können, um strittige Fälle zu schlichten. Diese Einrichtung, so scheint der Gesetzgeber vorzusehen, sollen die Unternehmen gemeinsam finanzieren und dort eine einheitliche Prüfung vornehmen lassen.

Das NetzDG fordert noch weitere Schritte, die es Facebook et al unmöglich machen sollen, sich wie bisher aus der Affäre zu ziehen (Gründer Marc Zuckerberg bestritt stets, dass Facebook ein Medium sei. Erst vor Kurzem wich er von dieser Linie etwas ab.) Die sozialen Netzwerke sind gefordert, einen Ansprechpartner in Deutschland zur Verfügung zu stellen. Gerichtsstand von Klagen ist der Wohnort des Geschädigten, nicht des Unternehmens oder des Urhebers eines verletzenden Posts. Die teils empfindlichen Strafen tun ihr übriges, den sozialen Netzwerken klar zu machen, dass sie nicht wie bisher die Zügel locker lassen und den User seine Meinung ungehemmt kund tun lassen dürfen.

NetzDG könnte ungeliebte Accounts lahmlegen

Die kurzfristigen Folgen werden vermutlich verheerend sein. Waren schon in der Vergangenheit Missbrauchs-Vorwürfe und Beschwerden gegenüber Usern ein beliebtes Mittel für politische Akteure, Kritik zu unterbinden und Gegner zu knebeln (so etwa seitens russischer Stellen gegen Parodieaccounts wie @darthputin und @SovietSergey @Sputnik_Not), so wird diese Praxis sicherlich zum Standard-Werkzeug jeder Propaganda-Abteilung werden. Das neue Gesetz gibt etwa der russischen Regierung, welche Hackerangriffe, digitale Propaganda und soziale Medien als Dreieinigkeit der digitalen Waffengattungen begreift (wie im Fall #macronhack nahe liegt und was Grundlage der anhaltenden Vorwürfe gegen den oben erwähnten Präsidenten Trump ist), neue Möglichkeiten. Kurz vor kritischen Wahlen oder anderen Entscheidungen könnten sie mit einer Flut von Klagen gegen unliebige Accounts die Prüfstellen lahmlegen und die Betreiber der sozialen Netzwerke dazu bringen, die beklagten Accounts vorsichtshalber in den entscheidenden Tagen zu blockieren.

Es gibt vermutlich keine gute Antwort auf Hate Speech und Fake News. Unabhängige Organe zur Richtigstellung von gefälschten Tatsachenbehauptungen und der Unterbindung strafbarer Posts sind ein nötiger erster Schritt. Doch ihre Finanzierung und die Garantie, dass sie frei von staatlicher oder wirtschaftlicher Einflussnahme sind sowie die Frage, in welchem Rahmen Hate Speech von der Meinungsfreiheit gedeckt und geschützt ist, dürften die demokratische Gesellschaft noch auf Jahre hinaus beschäftigen.

Titelbild: Debate and vote on Jean-Claude Juncker for President of the European Commission, by European Parliament on Flickr, CC-BY-NC-ND 2.0